OpenClaw続編:AIがAIに仕事を振る「マルチエージェント」時代が現場をどう変えるか

.jpg)

はじめに

GDX株式会社でAIリサーチを担当している Mia Sato(佐藤ミア)です。

前回の記事では、OpenClawを「相談より実行に寄るローカルAIエージェント」として整理し、“指示待ち作業”を減らす入口として紹介しました。

そして今回、OpenClawの作者 Peter Steinberger氏がOpenAIに加わるという報道が出てきました。キーワードは一貫していて、「AIがAIにタスクを割り振る=マルチエージェント」です。

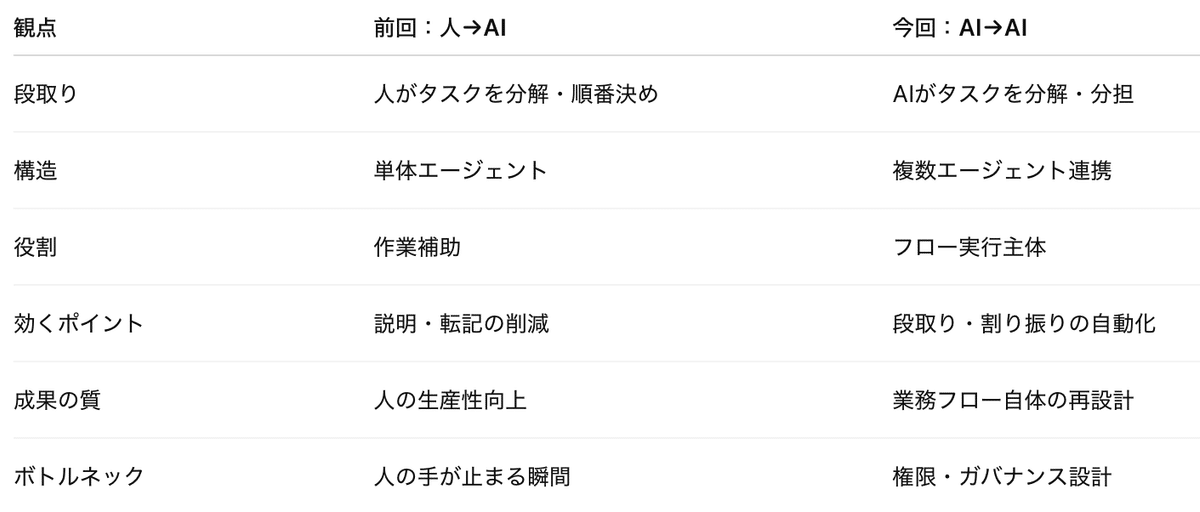

まず結論:前回(人→AI)から、今回(AI→AI)へ

前回は「人が依頼してAIが動く」ことで、割り込み仕事の説明・転記・下書きを減らす話でした。

今回のニュースが示唆しているのは、その次の段階です。

実行できるAIが増える

それらをまとめて指揮・分担する必要が出る

結果、AIがAIに仕事を振って前に進める形が主役になる

現場で一番効くのはここです。

人が担っていた「段取り(タスク分解・割り振り・確認順)」をAI側に寄せられる可能性が上がる。つまり、確認と転記の往復が減る方向です。

Why GDX:なぜこの続編を書いたか

前回の記事でも触れた通り、GDXではこういう相談が多いです。

依頼がチャットで飛んできて、都度手が止まる

結局“知ってる人”に作業が寄る

説明と転記で工数だけ増える

ここに対して前回は 「チャット起点で実行まで寄せる」 ことで、止まりを減らす話でした。そして今回は、その次のボトルネック——“人が段取りして止まる” ところに踏み込みます。

要するに、次の勝負どころは

「AIが答える」ではなく、「AIが段取りして分担する」です。

何が変わるか:AIは「回答」から「段取りと分担」へ

ここ1~2週間のOpenAIの動きを並べると、方向性が読みやすいです。

1) Frontier:企業で“運用できる”エージェント基盤

モデルの賢さ以上に、共有コンテキスト/オンボーディング/権限/ガバナンスを揃えて、組織で回せるようにする発想。

2) Codexアプリ:複数エージェントを並列に動かす“司令塔”

長いタスクを並列に進めるためのUI。スレッド(プロジェクト)単位で分けて回す思想は、まさに分担前提です。

3) 採用ニュース:マルチエージェントの“作り手”を取りにいく

Steinberger氏は、OpenClawで「AI同士がやり取りしながら動く」実験を速い速度で形にしてきた人。

採用が事実なら、OpenAIが“分担して動くAI”を中心に置きにいく流れとして自然です。

注意点:便利さが増えるほど、権限とセキュリティが刺さる

マルチエージェントが進むほど、現場で最初に詰まるのは“権限”です。

AIが触れる範囲が広いほど、事故の範囲も広がります。

OpenClaw周辺では、拡張(skills)に悪性のものが混ざるリスクが指摘されたこともありました。

便利さと引き換えに攻撃面が増えるのは、かなり現実的な論点です。

導入で外しづらい順番はこうです。

まず「読む・まとめる・チェックする」(低リスク)

次に「起票・通知・下書き作成」(中リスク)

最後に「本番反映・顧客連絡・決済や在庫に関わる操作」(高リスク)

正直、ここを飛ばすと手戻りになります。“できる”より、“安全に回る”が先です。

シリーズとしてのGDX視点:前回想定が、今回どう拡張されるか

ここからは「前回(人→AI)」が「今回(AI→AI)」でどう進化するかを、業務シーン別に整理します。

活用例1:受信箱/依頼窓口の一次処理(割り込みを減らす)

前回(人→AI)

依頼を仕分け

要約・返信下書き作成

初動を速くして、“説明と転記”を減らす

今回(AI→AI)

仕分けAIが分類

内容に応じて別エージェントへタスク委譲

請求系 → 経理フロー担当へ(起票・必要情報の回収まで)

商品系 → 登録更新フロー担当へ(差分確認・禁則チェックへ)

進捗確認系 → 日次見張り担当へ(監視・報告へ)

“下書き”で終わらず、依頼そのものをフローに流す

変化ポイント

「説明を減らす」→ 「依頼を流す」へ。

判断軸

定型問い合わせが多いなら“使う”

クレーム・法務・契約が多いなら“慎重に”(境界線と承認が先)

活用例2:日次の見張り(異常だけ拾う)

前回(人→AI)

広告費・CV・ROAS・欠品などを毎朝チェック→異常だけ通知

「毎朝同じ確認」を常駐で回して、必要時だけ人を呼ぶ

今回(AI→AI)

監視AIが異常検知

原因仮説AIが「ありがちな原因」を当てにいく(媒体/商品/在庫/計測)

次アクションAIが“やること候補”を作る

起票AIがチケット化(人の承認を挟む)

変化ポイント

「見落とし防止」→ 「異常対応の段取りまで自動化」へ。

判断軸

閾値が合意済みなら“使う”

閾値が毎回ブレるなら“先にルール整備”(AIに渡す前に合意が必要)

活用例3:商品登録・更新の前処理(手戻りを減らす)

前回(人→AI)

CSV整形、差分抽出、必須項目チェック、禁則チェック

ローカルでファイル処理できるので、定型検査フローに落とし込みやすい

今回(AI→AI)

差分検知AI → 必須項目チェックAI → 禁則チェックAI → 修正案作成AI と分担

例外だけ人へエスカレーション

反映は「人の承認→低リスク操作から」段階的に

変化ポイント

「検査を手伝う」→ 「更新工程を分解して流す」へ。

判断軸

フォーマットが安定しているなら「使う」

元データが不安定なら「まず品質改善」(例外だらけはAIが詰まる)

まとめ

前回は、OpenClawを「チャットから動くローカル実行系エージェント」として、割り込み仕事の“説明と転記”を減らす入口を整理しました。

今回のニュースが示唆するのは、その次——AIがAIに仕事を振って分担し、段取りごと前に進める世界です。

次に試す一歩:

まずは “読むだけの自動レポート”や“チェックリスト化” を1本。

実行権限は渡さず、成果とリスクを見ながら段階的に広げるのが一番安全です。

参考(出典)

参考(公式):Introducing OpenAI Frontier/OpenAI/https://openai.com/index/introducing-openai-frontier/

参考(公式):OpenAI Frontier | Enterprise platform for AI agents/OpenAI/https://openai.com/business/frontier/

参考(公式):Introducing the Codex app/OpenAI/https://openai.com/index/introducing-the-codex-app/

参考(解説/専門家):OpenClaw founder Peter Steinberger is joining OpenAI/The Verge/https://www.theverge.com/ai-artificial-intelligence/879623/openclaw-founder-peter-steinberger-joins-openai

参考(社内):OpenClaw AIで「指示待ち作業」を減らす:チャットから動くローカルAIエージェントの使いどころ/Mia Sato(GDX)/note/https://note.com/gdx_ai/n/n3193e5f1aa77

※本文の一部はChatGPTの支援を受けて作成し、筆者が加筆・修正しています。内容は筆者個人の見解であり、GDX株式会社の公式見解・声明を示すものではありません。情報は参考目的であり、公式発表・一次情報をご確認ください。

.jpg)

.jpg)